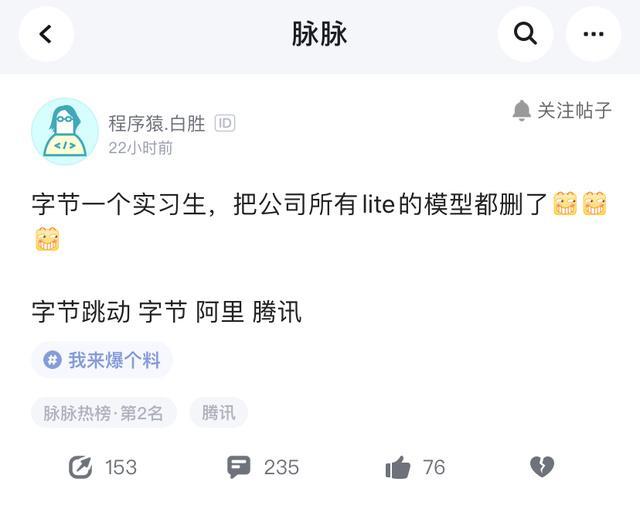

10月19日,字节跳动大模型训练遭到实习生攻击的事件引起了广泛关注。据知情人士透露,今年6月,字节跳动某技术团队内部发生了一起技术袭击事件,一名实习生因对团队资源分配不满,使用攻击代码破坏了团队的模型训练任务。

该事件的主要涉事者是一名田姓实习生。他利用Huggingface平台的漏洞,在公司的共享模型中写入了破坏代码,导致模型训练效果不稳定,无法达到预期成果。一位前字节技术员工表示,字节AI Lab的实习生权限和正职员工差异不大,这为此次事件提供了机会,并对此事可能带来的负面影响表达了担忧。

消息曝光后,涉事实习生试图在社交平台上辟谣,将责任推给他人,但很快遭到接近字节跳动人士的否认。相关知情人士在GitHub上指出,田某在长达两个月的时间里对集群代码进行恶意攻击,对公司近30位各级员工造成巨大伤害,使得同事一个季度的工作白费。所有记录和审查都证明这是不容置疑的事实。录音中的对话显示,田某最初输入的代码本用于调试,但后来通过更新文件变成了攻击代码,导致了一系列问题。田某在录音中承认了这一行为,并表示是因为某些原因导致了极大的不满。

虽然有传闻称此次损失超过千万美元,但内部人士表示实际损失并没有那么严重。据了解,事件发生于今年6月底,目前字节跳动已辞退田姓实习生,并将此事通报给相关行业联盟和其所在的学校。不过,除了被辞退外,田某未受到其他处罚。

多方消息显示,田姓实习生是国内某高校在读博士生,自2021年9月起在字节AI Lab实习。其所在团队在今年4月与北大王立威团队提出了VAR研究,在图像生成质量、推理速度、数据效率和可扩展性等方面均超过了DiT,推理速度比传统自回归模型快约20倍。截至发稿时,字节跳动方面仍未对此事进行公开回应。

转载请注明来自语言学习,本文标题:《字节跳动实习生投毒自家大模型细节曝光,影响到底有多大? 内部技术袭击引发权限收紧担忧》